この記事の主な参照ソース

- Prompt engineering guide(OpenAI 公式ドキュメント) — ChatGPT/GPT-4oで効果的なプロンプトを書くための公式ガイド

- Prompt engineering overview(Anthropic 公式ドキュメント) — Claude向けプロンプトの設計原則と実践テクニック

- Introduction to prompting(Google AI for Developers) — Geminiモデルへの効果的な指示出しの基本

ペタビットマーケティングでAIを利用して業務効率化やVibe Codingを行って開発等しています。不二樹です。

結論からお伝えすると、AIプロンプトの品質は「役割・文脈・出力形式・制約」の4要素を明示するだけで劇的に向上します。逆に、漠然とした質問では期待通りの回答を得ることは困難なんですよ。

「ChatGPTに聞いてみたけど、ぼんやりした回答しか返ってこない」「Claudeにお願いしたのに的外れな文章を書かれた」。AIを業務で使い始めた方から、こうした声をよく耳にします。

ってことで今回は、OpenAI・Anthropic・Googleの各公式ドキュメント(2026年3月時点)をもとに、プロンプトの基本原則から業務で即使えるテンプレートまでを解説していきます。

なぜプロンプトが重要なのか — 5つの基本原則

で、そもそもなぜプロンプトがそんなに大事かという話なんですが。AI(大規模言語モデル)は、入力されたテキスト(プロンプト)に基づいて回答を生成します。つまり、プロンプトの品質が出力の品質を直接決定するってわけです。

OpenAIの公式ドキュメントでは、以下のように説明されています。

“Better results can be achieved by providing more context, examples, and specific instructions in the prompt.”(より多くの文脈、例、具体的な指示をプロンプトに含めることで、より良い結果が得られる)

これはChatGPTに限った話ではなくて、Anthropicの公式ドキュメントでも、Claudeに対して「明確で具体的な指示が最良の結果を生む」と明記されています。要するにどのAIも「ちゃんと指示してくれないとわかんないよ」ってことなんですよね。

主要AIモデルの比較(2026年3月時点)

| モデル | 提供元 | 特徴 | プロンプトの傾向 |

|---|---|---|---|

| GPT-4o | OpenAI | マルチモーダル対応、高速 | System messageの活用が効果的 |

| Claude Opus 4.6 | Anthropic | 長文コンテキスト、推論力 | XMLタグによる構造化が得意 |

| Gemini 2.5 Pro | 100万トークン対応 | Few-shotの例示が効果的 |

注意:上記は2026年3月15日時点の情報です。AIモデルは頻繁に更新されるため、最新情報は各社の公式サイトをご確認ください。

ここからが本題です。個人的にいろいろ試してきた中で、特に効果が大きかった5つの原則をまとめました。

原則1: 役割を明示する(System / Role指定)

AIに「あなたは〇〇の専門家です」と役割を与えることで、回答の専門性と一貫性が向上します。これがまあ、地味に一番効くんですよね。

悪い例:

マーケティング戦略を教えて

良い例:

あなたはBtoB SaaS企業のマーケティング責任者です。 年間予算500万円の中小企業が、リード獲得を3倍にするための 6ヶ月間のマーケティング戦略を提案してください。

OpenAIはこれを「System message」として、Anthropicは「System prompt」として公式に推奨しています。

原則2: 文脈(コンテキスト)を十分に提供する

AIは提供された情報の範囲内で最善の回答を生成します。背景情報が不足していると、的外れな回答になります。含めるべき文脈は以下の4点です。

- 目的:なぜその情報が必要か

- 対象者:誰に向けた内容か

- 前提条件:すでに決まっていること

- 制約:予算・期間・技術的制限

原則3: 出力形式を指定する

「表形式で」「箇条書きで」「JSON形式で」など、期待する出力フォーマットを明示するだけで回答の使いやすさが格段に上がります。Anthropicの公式ドキュメントでは、XMLタグを使った出力構造の指定が特に効果的とされています。

以下の形式で回答してください: <analysis> <summary>要約(3文以内)</summary> <pros>メリット(箇条書き)</pros> <cons>デメリット(箇条書き)</cons> <recommendation>推奨アクション</recommendation> </analysis>

原則4: 具体例(Few-shot)を示す

ここで面白いのが、「こういう入力に対して、こういう出力が欲しい」という例を1〜3つ含めるだけで、AIの理解精度が飛躍的に向上するんですよ。これをFew-shot promptingと呼びます。Google AIの公式ドキュメントでも「最も効果的なプロンプト改善手法の一つ」として紹介されています。正直、これを知ってるだけでプロンプトの質がガラッと変わります。

原則5: 制約条件を明記する

AIに「やってほしくないこと」を伝えることも重要です。

- 文字数の上限・下限

- 使ってはいけない表現

- 回答に含めなくてよい情報

- トーン(カジュアル/フォーマル)

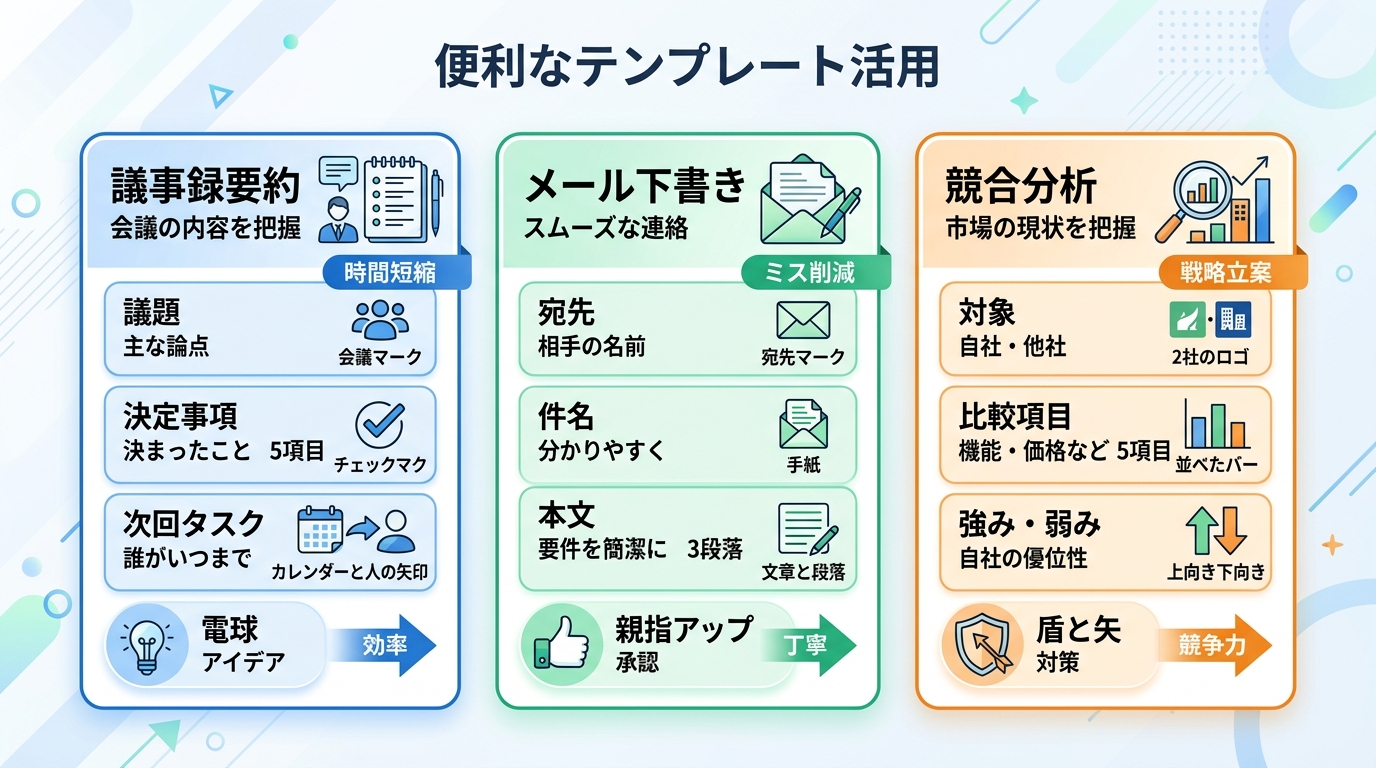

業務で即使えるプロンプトテンプレート3選

ってことで、原則がわかったところで実践編です。そのままコピペで使えるテンプレートを3つ紹介します。

テンプレート1: 議事録の要約

## タスク 以下の会議メモから、構造化された議事録を作成してください。 ## 出力形式 - 会議の概要(3文以内) - 決定事項(箇条書き) - TODO(担当者・期限付き) - 未解決の論点 ## 制約 - 参加者の発言は匿名化しない - 推測や解釈を加えない - 数値はそのまま記載 ## 会議メモ (ここにメモを貼り付け)

テンプレート2: メールの下書き

## タスク

以下の条件でビジネスメールを作成してください。

## 条件

- 宛先: {相手の役職・関係性}

- 目的: {メールの目的}

- トーン: {丁寧/カジュアル/フォーマル}

- 文字数: 200〜400字

## 含めるべき内容

- {ポイント1}

- {ポイント2}

- {ポイント3}

テンプレート3: 競合分析レポート

## タスク

{自社サービス名}と{競合サービス名}の比較分析を行ってください。

## 分析軸

1. 機能の違い

2. 価格体系

3. ターゲット顧客

4. 強み・弱み

## 出力形式

- 比較表(Markdown テーブル)

- 総評(5文以内)

- 差別化ポイントの提案(3つ)

## 注意

- 公開情報のみに基づく

- 推測は「※推測」と明記

やりがちなNG例と応用テクニック

正直に言ってしまえば、プロンプトで一番多い失敗は「曖昧すぎる指示」なんですよ。以下の表でチェックしてみてください。

| NG例 | 問題点 | 改善後 |

|---|---|---|

| 「いい感じにして」 | 基準が不明 | 「〇〇の観点で改善案を3つ提示して」 |

| 「全部教えて」 | 範囲が広すぎる | 「初心者が最初に学ぶべき3つに絞って」 |

| 「短くして」 | 曖昧 | 「200字以内で要約して」 |

| 「前に言ったこと覚えてる?」 | モデルの仕組みの誤解 | 必要な文脈を毎回含める |

| 1回のプロンプトに複数タスク | 回答が散漫になる | 1プロンプト1タスクに分割 |

Chain of Thought(思考の連鎖)

基本を押さえたら、もう一段上のテクニックも紹介しましょーぞ。複雑な問題では、「ステップバイステップで考えてください」と一言加えるだけで推論の精度が向上します。OpenAIの公式ドキュメントでも推奨されているテクニックです。個人的には、数値計算や比較分析の場面で特に効果を感じますね。

Iterative Refinement(段階的な改善)

一度で完璧な回答を求めるのではなく、対話を重ねて段階的に改善していくアプローチです。

- まず大まかな骨子を出してもらう

- 特定の部分について深掘りする

- フィードバックを与えて修正させる

- 最終版を出力させる

モデル固有のベストプラクティス

- ChatGPT:System messageに役割と制約をまとめる。Custom Instructionsの活用が効果的

- Claude:XMLタグで入出力を構造化する。長いドキュメントの分析が得意

- Gemini:マルチモーダル(画像+テキスト)入力を活用。長いコンテキストウィンドウが強み

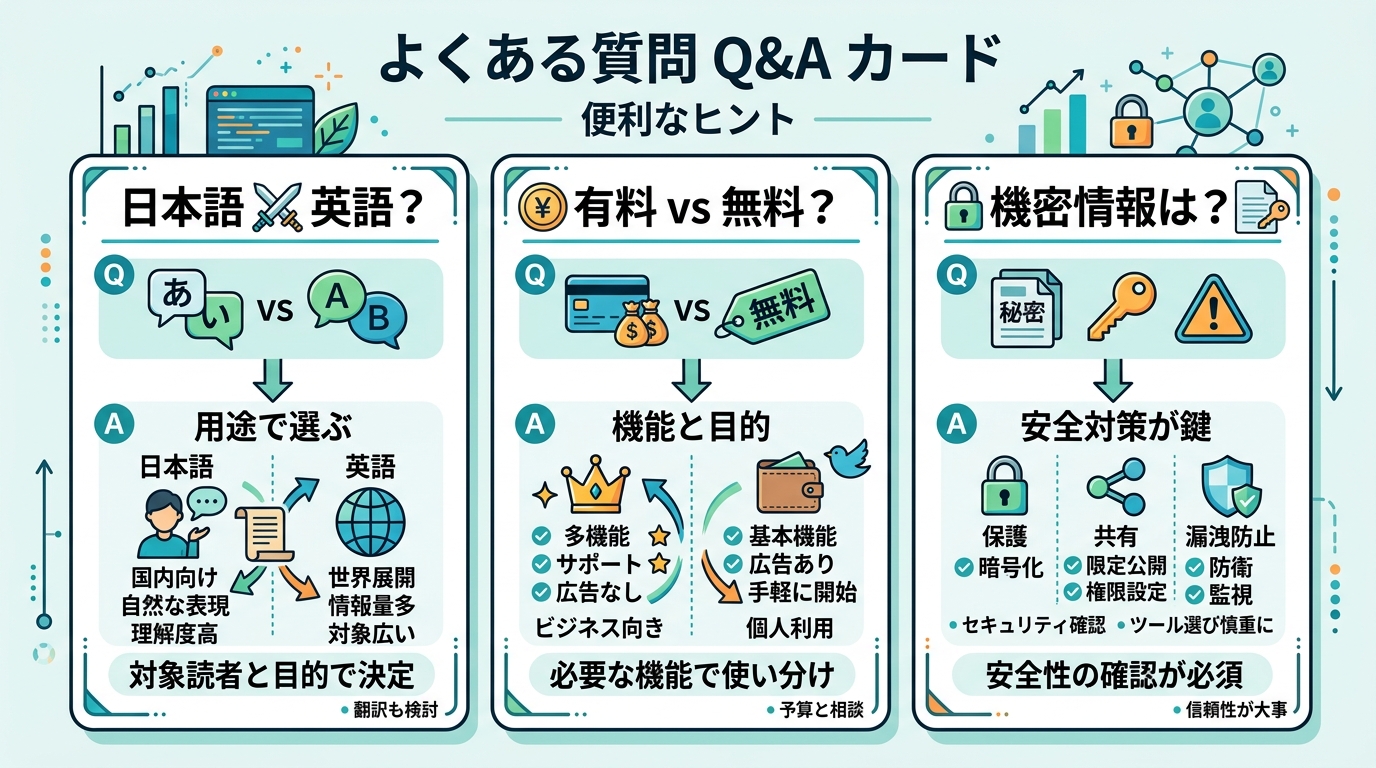

よくある質問(FAQ)

Q1. プロンプトは日本語と英語のどちらで書くべきですか?

A. 日本語で問題ありません。 2026年現在の主要モデルはいずれも日本語に対応しています。ただし、プログラミングや技術的なタスクでは英語の方が精度が高い場合があります。日本語で試してみて、品質に不満があれば英語に切り替えるのが実用的です。

Q2. 有料版と無料版でプロンプトの効果は変わりますか?

A. 変わります。 有料版で利用できる上位モデル(GPT-4o、Claude Opus 4.6など)は、複雑な指示への理解力が高く、同じプロンプトでもより高品質な出力が期待できます。業務利用であれば有料版を推奨します。

Q3. プロンプトに機密情報を入れても大丈夫ですか?

A. 慎重に判断してください。 OpenAI・Anthropicともに、API経由のデータはモデルの学習に使用しないポリシーを公開しています(2026年3月時点)。ただし、チャットUI(ChatGPT、claude.ai)経由の場合はオプトアウト設定が必要な場合があります。社内の情報セキュリティポリシーに従ってください。

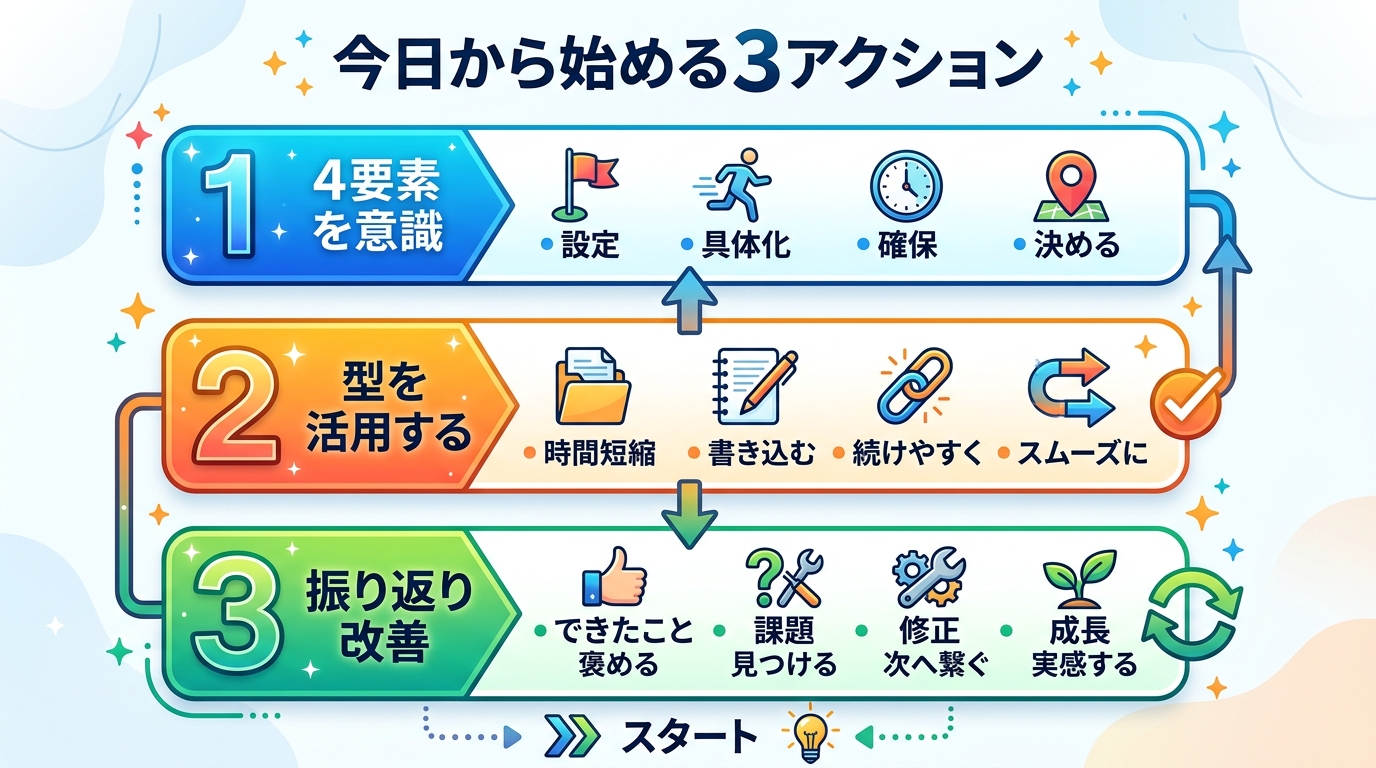

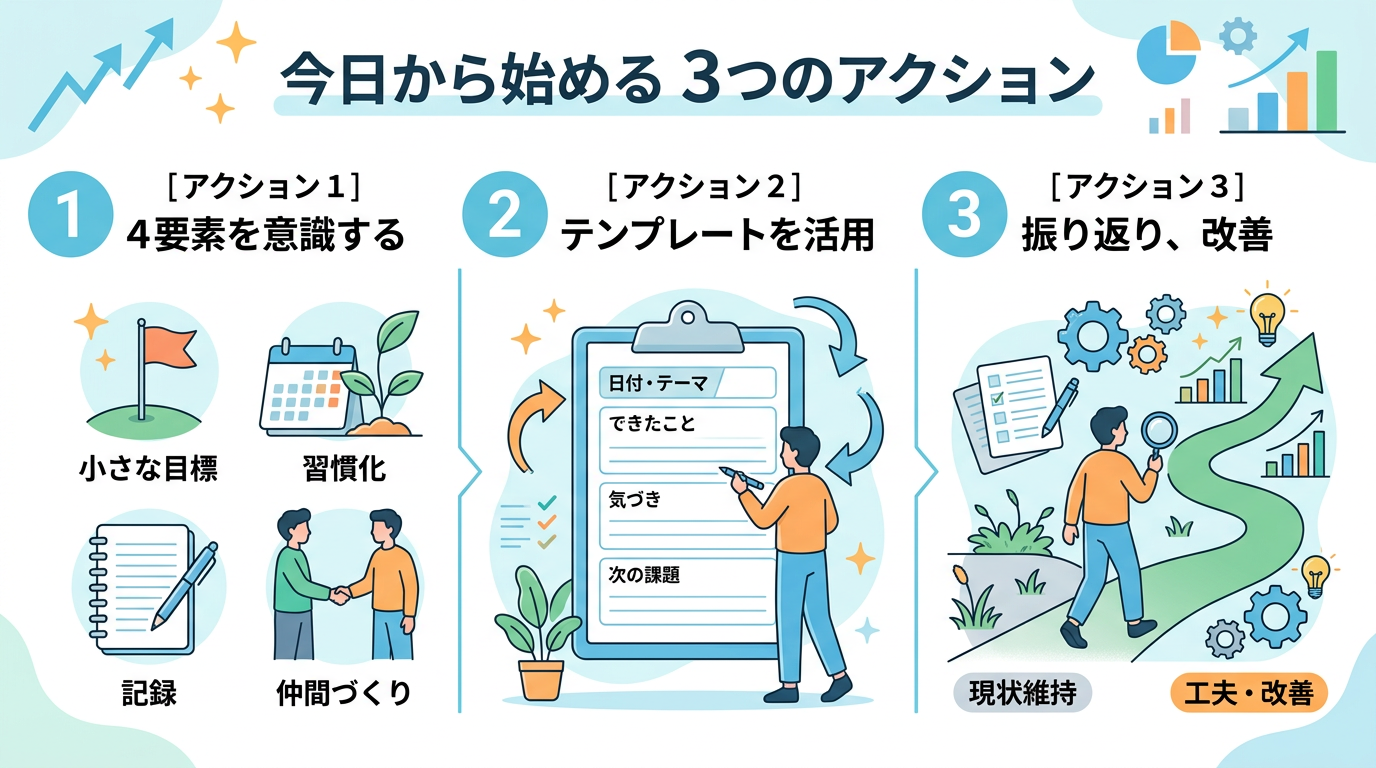

まとめ:今日から始める3つのアクション

ってことで、話をまとめると。プロンプトの品質を上げるために、今日からできることは以下の3つです。

- 役割・文脈・出力形式・制約の4要素を意識してプロンプトを書く

- 本記事のテンプレートをそのまま業務で使ってみる

- 「うまくいかなかった」プロンプトを振り返り、どの要素が不足していたか分析する

AIは指示の出し方ひとつで、まったく異なる結果を返します。「AIは使えない」と感じている方は、まずプロンプトの書き方を見直してみてください。個人的には、ここを変えるだけで仕事の効率がだいぶ変わると思うんですが、いかがでしょうか。

さらに学ぶには

- OpenAI Prompt Engineering Guide — 最も網羅的な公式リファレンス

- Anthropic Prompt Engineering Docs — Claude特有のテクニック集

- Google AI Prompting Guide — Geminiモデルの活用法