執行役員の鬼頭です。

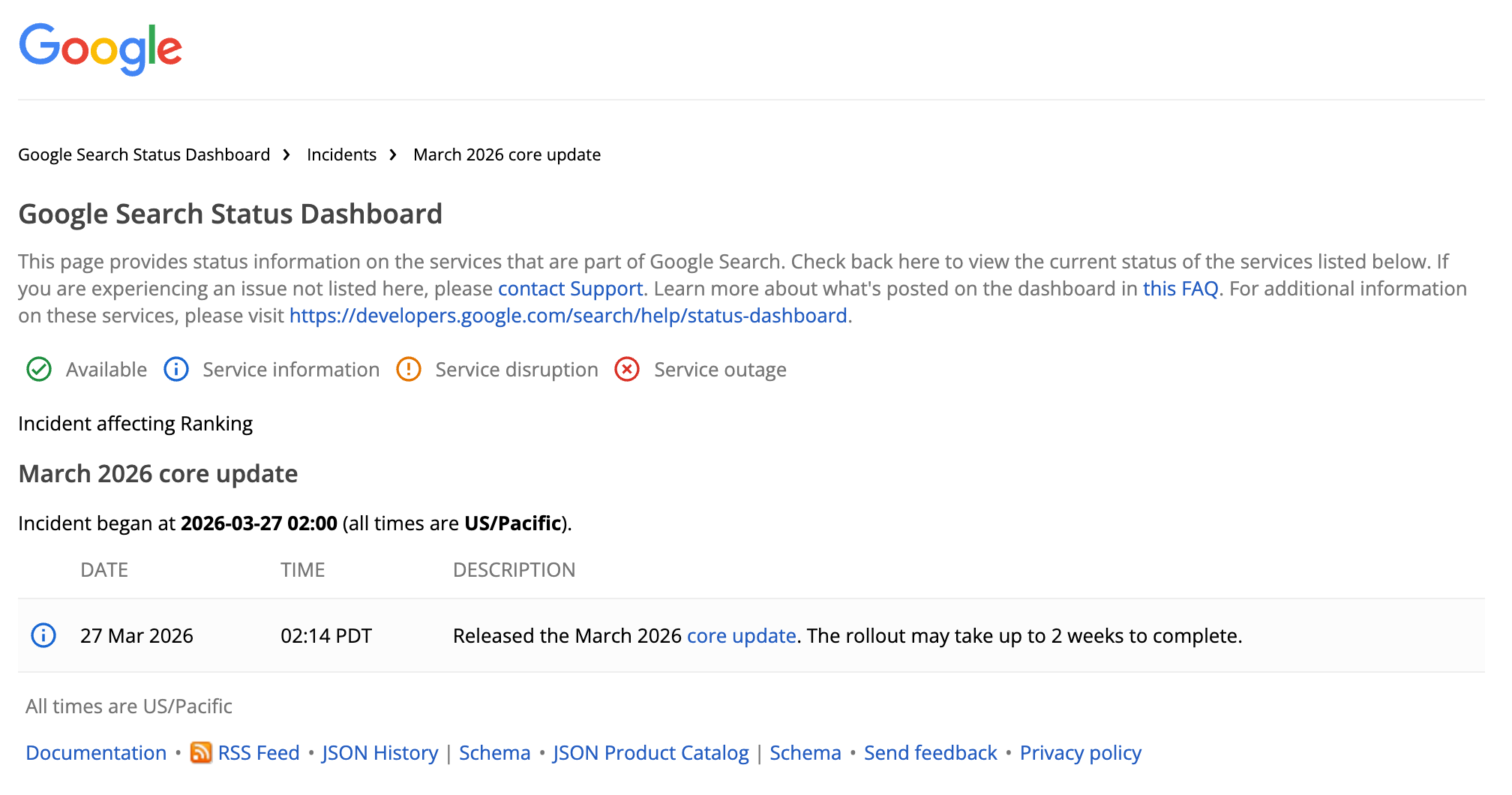

2026年3月27日(日本時間28日頃)、Googleが2026年最初の広範なコアアップデート「March 2026 Core Update」を開始しました。展開期間は最大2週間、4月上旬に完了する予定です。

直前の3月24〜25日にスパムアップデートが約20時間という異例の速さで完了したばかりで、そこにコアアップデートが続く「コンボ展開」という珍しい形になっています。SEO界隈では「やっと来たか」という反応が多く、発表前から検索結果の変動は観測されていました。

Googleの公式発表はシンプル

Googleの公式発表は毎回そうですが、今回も短いです。

「あらゆる種類のサイトから、検索ユーザーにとってより関連性が高く満足度の高いコンテンツを表示するための定期的なアップデート」

「新しいランキング要因の追加ではなく、既存のコンテンツ品質評価システムの再調整」という位置づけです。毎回同じような言い方ですが、実態はそれなりに大きな変動が起きています。

今回のアップデートで何が起きているか

AIコンテンツの単独生成は厳しくなった

海外のSEOコミュニティで最も話題になっているのがこの点です。「AIで50記事量産してバックリンクで上げる」という戦略が一夜で崩壊したという報告がRedditやXで相次いでいます。分析によると、人間の監修なしにAIだけで生成されたコンテンツは35〜60%以上の可視性低下が報告されています。

一方で「AIが下書きを作り、人間が実際の経験・事例・編集判断を加えたコンテンツ」は安定したパフォーマンスを示しているという分析も出ています。AIを使うこと自体が問題ではなく、「人間の知見が乗っているかどうか」が問われているということです。

Information Gain——「新しい価値があるか」

今回注目されているキーワードが「Information Gain(情報利得)」です。既存の上位コンテンツを言い換えているだけのページは順位を落とし、独自のデータ・ケーススタディ・一次情報を含むページが評価されているという分析が複数出ています。

これは考えてみれば当然の話で、検索上位に並んでいる記事と同じことを書いても、ユーザーにとっての価値がゼロです。「他のページでは読めないことが書いてあるか」が問われています。

E-E-A-Tの強化——特にYMYL領域

医療・金融・法律などYMYL(Your Money or Your Life)領域での影響が大きく、上位ランキングページの73%が明確で検証可能な著者情報と専門性を持っているという分析があります。著者名・プロフィール・資格・出典の明記が引き続き重要です。

GoogleのJohn Mueller氏は今回のアップデートについて「自分のサイトがスパムかどうか経験を積んでも判断できないなら、それはたぶんスパムです」とシンプルに言い切っています。厳しいですが正しい。

パラサイトSEOの終わり

権威あるドメイン上の弱いページが、ドメインの強さに関係なく独立して評価されるようになっています。大きなドメインにぶら下がって順位を上げるという手法が効かなくなってきています。

今すぐやること・やらないこと

アップデートはまだロールアウト中です(4月上旬完了予定)。専門家の一致した見解は「完了前に慌てて大きな修正を加えるな」です。

今やること:Google Search ConsoleとGA4でトラフィック・順位の変動を観測する。どのページが上がり、どのページが落ちているかを把握するだけでいい。

完了後にやること:影響を受けたページを確認し、「このページは他のページと比べて何が新しいか」「著者情報・出典は明記されているか」「ユーザーが求めている情報を本当に満たしているか」を見直す。技術面ではLCP 2.5秒未満・INP 200ms未満・CLS 0.1未満を目安にCore Web Vitalsを確認する。

やらないこと:日々の変動に一喜一憂して急な修正を加えること。ロールアウト中は数値が安定しないため、完了を待ってから判断する。

マーケター視点で思うこと

正直に言うと、今回のアップデートで打撃を受けているサイトの多くは、最初からやるべきでなかったことをやっていたと思います。AIで大量生成して量でカバーする戦略は、「検索エンジンを騙す」という発想を前提にしていて、ユーザーにとっての価値は後回しです。それがまた是正された、というだけです。

私たちのペタビットマーケティングブログもAIを使って書いています。ただ、「AIが書いて私が何も加えない記事」は一本もありません。クライアントとの実際の課題、自分たちが試して失敗したこと、業界の動きに対して実務者として思うことを入れています。それが「Information Gain」であり「E-E-A-T」の実態だと思っています。

コアアップデートへの対策は「Googleの基準に合わせる」より「読んだ人に本当に役立つものを書く」という当たり前のことに尽きます。そうすれば長期的にはアップデートに強くなります。

おまけ:コアアップデートと同時期に公開されたGooglebotの仕様明記

コアアップデートと同じタイミングで、Google公式ブログがGooglebotのクロール仕様を改めて詳細に解説する記事を公開しました。SEO担当者は知っておくべき内容です。

GooglebotはHTMLの最初の2MBしか読まない

Googleの公式ドキュメントに明記されています。GooglebotはHTMLファイルの最初の2MBまでしかクロールせず、それを超えた部分はクロールもインデックスもされません。 2MBを超えた部分は「存在しない扱い」になります。

2MBというと大きく聞こえますが、肥大しがちなサイトでは現実的な問題になります。よくある事故のパターンはこうです。

- ナビゲーションや装飾のHTMLが膨大で、本文が下に押し出される

- 構造化データをフッターに置いている

- インラインCSSやbase64の画像埋め込みでHTMLが肥大している

- SPAでJavaScriptによって後から読み込むコンテンツが多い

いずれも「ブラウザでは表示されているのに、Googleには見えていない」状態を引き起こします。JavaScriptも取得された範囲内しか実行されないため、クライアントサイドレンダリングに依存したSPAは特に注意が必要です。

対策はシンプル:重要なものを上に置く

title・meta・canonical・構造化データ・本文はHTMLの上位に配置する。インラインCSS・JSを減らしてHTMLを軽くする。可能であればSSRやSSGにして初期HTMLにコンテンツを含める。これだけです。

SEOは「何を書くか」だけでなく「どこに置くか」でも勝負が決まります。コンテンツの質を上げる前に、Googlebotにそのコンテンツが見えているかどうかを確認することが先決です。

SEOや広告運用の戦略についてご相談したい方はお問い合わせください。

参考:Search Engine Land/Search Engine Journal/Search Engine Roundtable/ClickRank/Google Search Central Blog「Inside Googlebot」/Google公式「What Is Googlebot」